到目前为止,我们研究的所有对象——向量子空间和线性映射——都严格地与“原点”绑定。子空间必须穿过原点,线性映射必须保持原点不变。然而,在几何和实际应用中,我们经常遇到不过原点的直线、平面,以及包含平移的变换。仿射空间和仿射映射就是将线性代数的理论拓展到这些更一般情况的框架。

1. 仿射子空间 (Affine Subspaces)#

准确的数学定义 (Definition 2.25)

设 \(V\) 是一个向量空间,\(\boldsymbol{x}_0 \in V\) 是一个特定的向量,而 \(U \subseteq V\) 是一个向量子空间。那么,集合:

$$ L = \boldsymbol{x}_0 + U := \{\boldsymbol{x}_0 + \boldsymbol{u} \mid \boldsymbol{u} \in U\} $$被称为 \(V\) 的一个仿射子空间 (affine subspace) 或线性流形 (linear manifold)。

- 变量说明:

- \(\boldsymbol{x}_0\) 被称为支撑点 (support point) 或平移向量 (translation vector)。

- \(U\) 被称为方向空间 (direction space)。

直观解释

仿射子空间就是将一个标准的向量子空间(必须过原点)进行整体平移,使其离开原点。

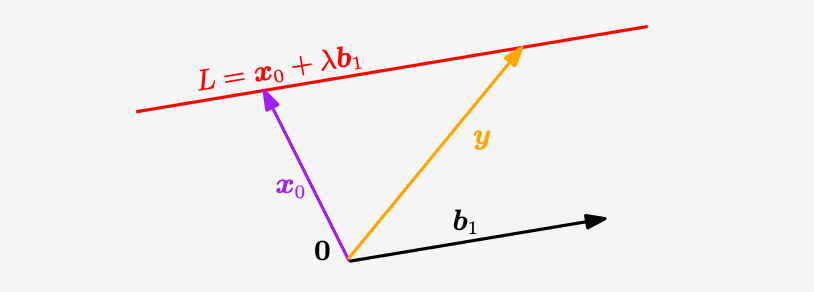

- 如果方向空间 \(U\) 是一条过原点的直线,那么 \(L = \boldsymbol{x}_0 + U\) 就是一条穿过点 \(\boldsymbol{x}_0\) 并与 \(U\) 平行的直线。

- 如果方向空间 \(U\) 是一个过原点的平面,那么 \(L = \boldsymbol{x}_0 + U\) 就是一个穿过点 \(\boldsymbol{x}_0\) 并与 \(U\) 平行的平面。

核心区别:仿射子空间不一定是向量子空间,因为它通常不包含零向量 \(\boldsymbol{0}\)(除非 \(\boldsymbol{x}_0\) 恰好在 \(U\) 中,此时仿射子空间退化为向量子空间)。

参数化表示 (Parametric Equation)

如果方向空间 \(U\) 的一组基是 \(\{\boldsymbol{b}_1, \dots, \boldsymbol{b}_k\}\),那么仿射子空间 \(L\) 中的任何一个向量 \(\boldsymbol{x}\) 都可以被唯一地表示为:

$$ \boldsymbol{x} = \boldsymbol{x}_0 + \lambda_1\boldsymbol{b}_1 + \lambda_2\boldsymbol{b}_2 + \cdots + \lambda_k\boldsymbol{b}_k $$其中 \(\lambda_1, \dots, \lambda_k\) 是实数参数。

数值示例 (Example 2.26)

直线 (Line): \(\mathbb{R}^n\) 中的一维仿射子空间。由一个支撑点 \(\boldsymbol{x}_0\) 和一个非零方向向量 \(\boldsymbol{b}_1\) 定义。

$$ \boldsymbol{y} = \boldsymbol{x}_0 + \lambda \boldsymbol{b}_1, \quad \lambda \in \mathbb{R} $$平面 (Plane): \(\mathbb{R}^n\) 中的二维仿射子空间。由一个支撑点 \(\boldsymbol{x}_0\) 和两个线性无关的方向向量 \(\boldsymbol{b}_1, \boldsymbol{b}_2\) 定义。

$$ \boldsymbol{y} = \boldsymbol{x}_0 + \lambda_1 \boldsymbol{b}_1 + \lambda_2 \boldsymbol{b}_2, \quad \lambda_1, \lambda_2 \in \mathbb{R} $$超平面 (Hyperplane): \(\mathbb{R}^n\) 中的 \((n-1)\) 维仿射子空间。例如,\(\mathbb{R}^3\) 中的平面就是超平面。

与线性方程组的联系

- 齐次方程 \(\boldsymbol{A}\boldsymbol{x} = \boldsymbol{0}\) 的解集是一个向量子空间(方向空间 \(U\))。

- 非齐次方程 \(\boldsymbol{A}\boldsymbol{x} = \boldsymbol{b}\) (当有解时) 的解集是一个仿射子空间。它的通解 \(\boldsymbol{x} = \boldsymbol{x}_p + \boldsymbol{x}_h\) 完美地符合了仿射子空间的定义,其中 \(\boldsymbol{x}_p\) 是支撑点,\(\boldsymbol{x}_h\)(即齐次解集)是方向空间。

2. 仿射映射 (Affine Mappings)#

仿射映射是在仿射空间之间的一种保持其几何结构的“良好”变换。

准确的数学定义 (Definition 2.26)

对于两个向量空间 \(V, W\),一个线性映射 \(\Phi: V \to W\) 和一个平移向量 \(\boldsymbol{a} \in W\),形如:

$$ \phi(\boldsymbol{x}) = \Phi(\boldsymbol{x}) + \boldsymbol{a} $$的映射 \(\phi: V \to W\) 被称为一个仿射映射 (affine mapping)。

直观解释

仿射映射可以被分解为一个线性变换(旋转、缩放、剪切等)和其后的一个平移 (translation)。

$$ \text{仿射变换} = \text{线性变换} + \text{平移} $$重要性质:

- 仿射映射将直线映射为直线,将平面映射为平面。

- 仿射映射保持平行关系。

- 仿射映射的复合仍然是仿射映射。

- 与线性映射不同,仿射映射不一定保持原点不变。

与机器学习的联系

在机器学习中,我们遇到的很多“线性”模型,实际上是仿射模型。

- 线性回归: 一个标准的线性回归模型 \(y = \boldsymbol{w}^T\boldsymbol{x} + b\)。其中,\(\boldsymbol{w}^T\boldsymbol{x}\) 是一个线性映射部分,而偏置项(或截距)\(b\) 就是平移向量。因此,这是一个仿射映射。如果没有偏置项 \(b\),它才是严格的线性映射。

- 神经网络: 神经网络中的每一层通常都由一个线性变换(权重矩阵 \(\boldsymbol{W}\) 的乘法)和一个平移(偏置向量 \(\boldsymbol{b}\) 的加法),然后跟一个非线性的激活函数构成。其核心部分 \(\boldsymbol{W}\boldsymbol{x}+\boldsymbol{b}\) 就是一个仿射变换。

理解要点

仿射的概念是将线性代数的适用范围从“严格过原点”的世界解放出来的关键。通过增加一个“平移”项,我们可以用线性代数强大的理论和工具来分析更广泛、更符合现实世界的几何对象和数据变换。

本节知识点总结#

- 仿射子空间: 一个向量子空间经过平移后得到的几何对象(如不过原点的线、面)。其结构为 \(L = \text{支撑点} + \text{方向空间}\)。

- 与方程组的联系: 非齐次方程组的解集是一个仿射子空间。

- 仿射映射: 一个线性变换后跟一个平移,其形式为 \(\phi(\boldsymbol{x}) = \boldsymbol{A}\boldsymbol{x} + \boldsymbol{b}\)。

- 与机器学习的关系: 许多包含偏置项(bias/intercept)的机器学习模型,其本质都是仿射映射,而非严格的线性映射。

总结与思想脉络#

至此,我们已经完成了线性代数基础理论的学习。让我们回顾一下本章的逻辑脉络:

- 从一个具体问题 [线性方程组] 出发。

- 为了高效地表示它,引入了核心工具 [矩阵]。

- 为了系统地求解它,发展了 [高斯消元法],并在此过程中发现了“解的结构”。

- 将解的结构抽象化,提炼出 [向量空间与子空间] 的公理化定义,这是我们理论的舞台。

- 为了度量这个舞台,我们引入了 [线性无关性]、[基]、[维度] 和 [秩] 等概念,它们构成了空间的“骨架”和“度量衡”。

- 接着,我们研究了舞台间的变换,即保持结构的 [线性映射],并发现它与 [矩阵] 之间存在深刻的等价关系,同时揭示了 [核] 与 [像] 这两个核心子空间。

- 最后,通过引入“平移”,我们将理论从线性空间拓展到更普适的 [仿射空间],使其能更好地描述现实世界的问题。

这个从“具体”到“抽象”再回归“应用”的过程,是学习线性代数的有效路径。这些基础概念,如向量、矩阵、秩、基、线性映射,将在后续学习对角化、特征值、主成分分析(PCA)以及各种机器学习算法中反复出现,是构建更高阶知识的坚实地基。